Die digitale Landschaft verändert sich kontinuierlich, doch eines bleibt konstant: Ohne eine solide technische Grundlage können selbst die besten Inhalte ihre volle Wirkung nicht entfalten. Die technische SEO Optimierung bildet das Fundament, auf dem alle weiteren Maßnahmen der Suchmaschinenoptimierung aufbauen. Sie entscheidet darüber, ob Suchmaschinen Ihre Website effizient crawlen, korrekt indexieren und in den Suchergebnissen prominent platzieren können. In einer Zeit, in der Google-Algorithmen zunehmend auf Nutzererfahrung und Performance achten, während gleichzeitig KI-basierte Suchsysteme neue Standards setzen, gewinnt die technische Optimierung an Bedeutung. Dieser Leitfaden zeigt Ihnen systematisch, welche technischen Aspekte 2026 wirklich zählen und wie Sie diese gezielt verbessern.

Grundlagen der technischen SEO Optimierung

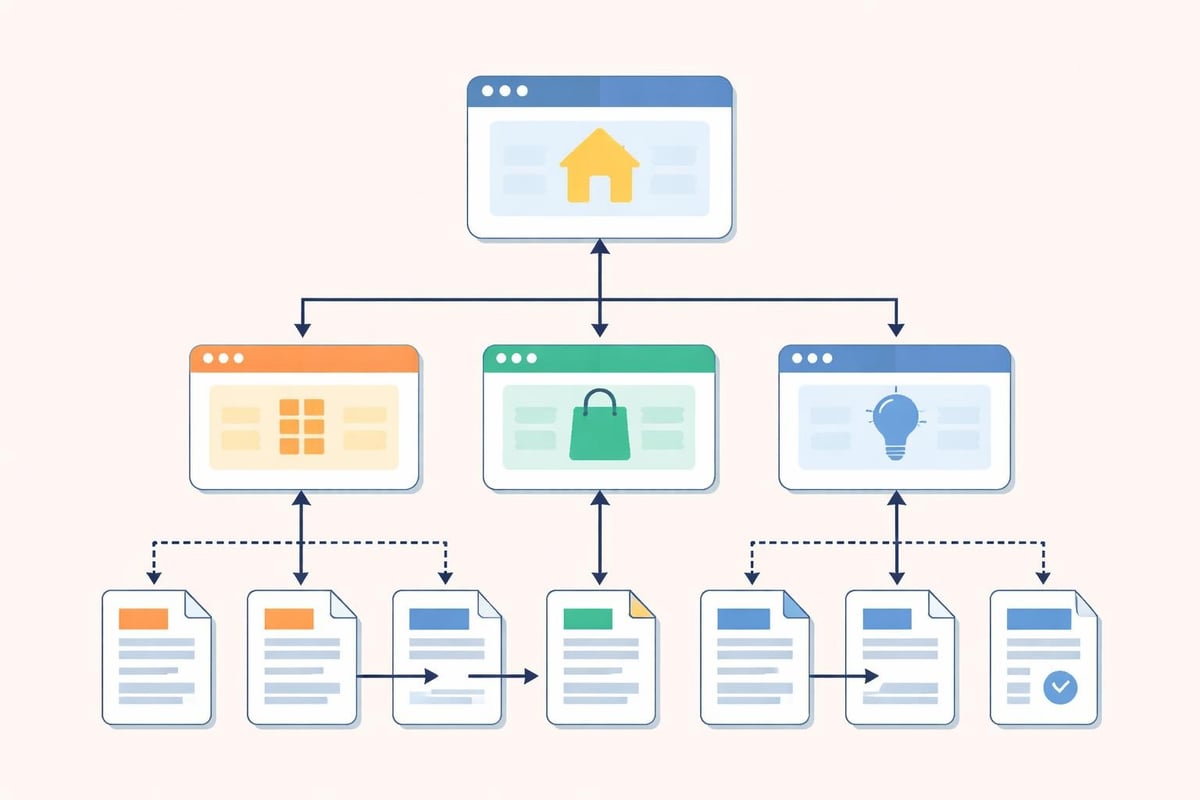

Die technische SEO Optimierung umfasst alle Maßnahmen, die die technische Infrastruktur einer Website verbessern, um Suchmaschinen das Crawlen, Indexieren und Verstehen der Inhalte zu erleichtern. Im Gegensatz zur inhaltlichen Optimierung, die sich auf Keywords und Content-Qualität konzentriert, geht es hier um die architektonische Basis Ihrer digitalen Präsenz.

Warum technische Optimierung unverzichtbar ist

Suchmaschinen wie Google verwenden komplexe Crawler-Systeme, die Milliarden von Webseiten täglich analysieren. Diese Systeme haben ein begrenztes Crawl-Budget für jede Domain. Wenn Ihre Website technische Barrieren aufweist, verschwenden Sie wertvolle Ressourcen und riskieren, dass wichtige Seiten nicht indexiert werden.

Zentrale Vorteile einer professionellen technischen Optimierung:

- Verbesserte Crawling-Effizienz durch klare Seitenstrukturen

- Schnellere Indexierung neuer und aktualisierter Inhalte

- Höhere Sichtbarkeit in Suchergebnissen durch bessere Rankings

- Optimale Nutzererfahrung durch schnelle Ladezeiten

- Reduzierte Absprungraten und erhöhte Conversion-Raten

- Bessere Performance in mobilen Suchergebnissen

Die Grundlagen der technischen SEO haben sich in den letzten Jahren deutlich erweitert. Was früher hauptsächlich Servereinstellungen und XML-Sitemaps umfasste, schließt heute komplexe Themen wie Core Web Vitals, strukturierte Daten und JavaScript-Rendering ein.

Crawling und Indexierung optimieren

Die Fähigkeit von Suchmaschinen, Ihre Website zu durchsuchen und zu indexieren, steht am Anfang jeder erfolgreichen SEO-Strategie. Ohne korrekte Indexierung existieren Ihre Inhalte für die Suchmaschine praktisch nicht.

Robots.txt strategisch einsetzen

Die robots.txt-Datei ist Ihre erste Kommunikationslinie mit Suchmaschinen-Crawlern. Sie definiert, welche Bereiche Ihrer Website gecrawlt werden dürfen und welche ausgeschlossen bleiben sollen.

User-agent: *

Disallow: /admin/

Disallow: /temp/

Allow: /

Sitemap: https://www.bitgi.de/sitemap.xml

Häufige Fehler bei der robots.txt-Konfiguration:

- Versehentliches Blockieren wichtiger Ressourcen wie CSS oder JavaScript

- Widersprüchliche Anweisungen für verschiedene User-Agents

- Fehlende Sitemap-Referenz

- Blockierung von produktiven Seiten statt Entwicklungsumgebungen

XML-Sitemaps professionell strukturieren

Eine gut strukturierte XML-Sitemap beschleunigt die Entdeckung neuer Inhalte erheblich. Moderne Sitemaps sollten dynamisch generiert werden und relevante Metadaten enthalten.

| Sitemap-Element | Funktion | Optimierungspotenzial |

|---|---|---|

<loc> |

URL-Angabe | Nur indexierbare Seiten einbeziehen |

<lastmod> |

Änderungsdatum | Automatisch aktualisieren bei Content-Updates |

<changefreq> |

Änderungshäufigkeit | Realistisch einschätzen (nicht alle täglich) |

<priority> |

Prioritätswert | Wichtige Seiten mit 0.8-1.0 kennzeichnen |

Die Implementierung einer korrekten Sitemap-Struktur erleichtert Suchmaschinen die Priorisierung Ihrer Inhalte. Teilen Sie große Websites in mehrere thematische Sitemaps auf und verwenden Sie eine Sitemap-Index-Datei als übergeordnete Struktur.

Meta-Robots und Canonical-Tags richtig verwenden

Meta-Robots-Tags auf Seitenebene ergänzen die robots.txt-Direktiven und bieten granulare Kontrolle über die Indexierung einzelner Seiten. Die korrekte Verwendung von Canonical-Tags verhindert Duplicate Content-Probleme.

Wichtige Meta-Robots-Direktiven:

index, follow– Standard für alle wichtigen Seitennoindex, follow– Für dünne Inhalte, die Links weitergeben sollenindex, nofollow– Selten verwendet, hauptsächlich für nutzergenerierte Inhaltenoindex, nofollow– Für komplett auszuschließende Seiten

Performance-Optimierung als Ranking-Faktor

Die Geschwindigkeit einer Website beeinflusst direkt sowohl das Nutzererlebnis als auch die Rankings. Google hat mit den Core Web Vitals klare Metriken definiert, die 2026 noch stärker gewichtet werden.

Core Web Vitals verstehen und verbessern

Die drei Haupt-Metriken der Core Web Vitals messen unterschiedliche Aspekte der Nutzererfahrung. Technische SEO-Maßnahmen zur Verbesserung dieser Werte zahlen sich mehrfach aus.

| Metrik | Messgröße | Zielwert | Optimierungsansätze |

|---|---|---|---|

| Largest Contentful Paint (LCP) | Ladezeit des größten sichtbaren Elements | < 2.5 Sekunden | Server-Response optimieren, Bilder komprimieren, Lazy Loading |

| First Input Delay (FID) | Reaktionszeit auf erste Nutzerinteraktion | < 100 Millisekunden | JavaScript minimieren, Code splitting, Web Worker nutzen |

| Cumulative Layout Shift (CLS) | Visuelle Stabilität während des Ladens | < 0.1 | Dimensionen für Medien definieren, Font-Loading optimieren |

Die Verbesserung dieser Metriken erfordert einen ganzheitlichen Ansatz. Server-Infrastruktur, Content Delivery Networks (CDN), Code-Qualität und Ressourcen-Management müssen optimal zusammenspielen.

Ladezeit-Optimierung durch technische Maßnahmen

Schnelle Ladezeiten beginnen auf dem Server. Die Wahl des Hosting-Anbieters, die Server-Konfiguration und die Implementierung von Caching-Strategien bilden die Basis.

Prioritäre technische Optimierungen:

- Server-Response-Time reduzieren durch leistungsfähige Hardware und optimierte Datenbank-Abfragen

- HTTP/3 und QUIC-Protokoll implementieren für schnellere Verbindungen

- Gzip- oder Brotli-Kompression für alle Text-basierten Ressourcen aktivieren

- Browser-Caching mit optimalen Cache-Control-Headern konfigurieren

- Content Delivery Network einsetzen für globale Verfügbarkeit

- Datenbankabfragen optimieren und Indizes strategisch setzen

Die Verbesserung der Ladegeschwindigkeit ist ein kontinuierlicher Prozess. Regelmäßige Performance-Audits decken neue Optimierungspotenziale auf, die durch Content-Updates oder technische Änderungen entstehen.

Bilder und Medien effizient ausliefern

Bilder machen oft 50-70% des Gesamtgewichts einer Webseite aus. Moderne Bildformate und intelligente Ladestrategien reduzieren die Datenmenge drastisch.

Bildoptimierungs-Strategien für 2026:

- WebP und AVIF als Standard-Formate mit Fallback auf JPEG

- Responsive Images mit srcset für verschiedene Bildschirmgrößen

- Lazy Loading für Bilder unterhalb des Viewport

- Explizite Breiten- und Höhenangaben zur CLS-Vermeidung

- CDN-basierte automatische Bildoptimierung

- Video-Thumbnails statt Auto-Play für Hintergrundvideos

Mobile-First und responsive Technologie

Google verwendet seit Jahren Mobile-First-Indexing, was bedeutet, dass die mobile Version Ihrer Website die primäre Grundlage für Rankings bildet. Die technische SEO Optimierung muss daher mobile Geräte priorisieren.

Responsive Design technisch umsetzen

Responsive Webdesign ist kein optionales Feature mehr, sondern technische Grundvoraussetzung. Die Implementierung erfordert jedoch mehr als nur flexible CSS-Grid-Layouts.

Technische Anforderungen für optimales Mobile-First:

- Viewport-Meta-Tag korrekt konfiguriert

- Touch-freundliche Elemente mit mindestens 48x48 Pixel

- Vermeidung von horizontalem Scrollen bei allen Bildschirmgrößen

- Angepasste Schriftgrößen ohne Zoom-Notwendigkeit

- Optimierte Formulare mit geeigneten Input-Typen

- Schnelle mobile Ladezeiten unter 3 Sekunden

Die Implementierung von Accelerated Mobile Pages (AMP) ist 2026 weniger kritisch als früher, da moderne Web-Technologien vergleichbare Geschwindigkeiten ermöglichen. Der Fokus sollte auf einer durchgängig optimierten mobilen Erfahrung liegen.

Mobile Usability Testing

Regelmäßige Tests auf verschiedenen Geräten und Bildschirmgrößen decken technische Probleme auf, die Desktop-Tests übersehen. Die Google Search Console bietet ein dediziertes Mobile Usability-Tool, das häufige Probleme identifiziert.

Strukturierte Daten und Schema Markup

Strukturierte Daten helfen Suchmaschinen, den Kontext Ihrer Inhalte besser zu verstehen. Die technische SEO-Optimierung umfasst heute zwingend die Implementation von Schema.org-Markup.

Relevante Schema-Typen für unterschiedliche Branchen

Die Wahl des passenden Schema-Markups hängt von Ihrem Geschäftsmodell ab. Verschiedene Branchen profitieren von unterschiedlichen strukturierten Daten.

| Branche | Primäre Schema-Typen | Nutzen |

|---|---|---|

| Restaurants | LocalBusiness, Restaurant, Menu | Öffnungszeiten, Speisekarten in Suchergebnissen |

| Ärzte | Physician, MedicalBusiness | Fachgebiete, Bewertungen, Terminbuchung |

| Anwälte | Attorney, LegalService | Rechtsgebiete, Standorte, Beratungszeiten |

| Hotels | Hotel, LodgingBusiness | Verfügbarkeit, Preise, Bewertungen |

| E-Commerce | Product, Offer, Review | Produktinformationen, Preise, Verfügbarkeit |

Für lokale Unternehmen wie Restaurants in Frankfurt oder Steuerberater in Frankfurt ist das LocalBusiness-Schema besonders wertvoll. Es ermöglicht die Anzeige in Google Maps und lokalen Suchergebnissen mit erweiterten Informationen.

JSON-LD als bevorzugtes Format

Google empfiehlt JSON-LD als Format für strukturierte Daten, da es von anderen Code-Elementen getrennt implementiert werden kann. Dies vereinfacht die Wartung und reduziert Fehlerquellen.

Beispiel für LocalBusiness JSON-LD:

{

"@context": "https://schema.org",

"@type": "LocalBusiness",

"name": "BITGI SEO Agentur",

"description": "Moderne SEO- und Webdesign-Agentur",

"url": "https://bitgi.de",

"telephone": "+49-...",

"address": {

"@type": "PostalAddress",

"addressLocality": "Frankfurt",

"addressCountry": "DE"

}

}

Die Validierung strukturierter Daten mit dem Schema Markup Validator von Google ist essentiell. Fehlerhafte Implementierungen können zu Problemen statt Vorteilen führen.

HTTPS und Website-Sicherheit

Sicherheit ist seit 2014 ein offizieller Ranking-Faktor. Die Implementierung von HTTPS ist nicht nur technisch notwendig, sondern auch vertrauensbildend für Nutzer.

SSL/TLS-Zertifikate korrekt implementieren

Die bloße Installation eines SSL-Zertifikats reicht nicht aus. Die technische SEO Optimierung erfordert eine vollständige und korrekte Umsetzung ohne Mixed Content-Warnungen.

Checkliste für sichere HTTPS-Implementation:

- Gültiges SSL/TLS-Zertifikat von vertrauenswürdiger Zertifizierungsstelle

- Automatische Weiterleitung von HTTP zu HTTPS (301-Redirect)

- HSTS-Header (HTTP Strict Transport Security) konfiguriert

- Alle internen Links auf HTTPS aktualisiert

- Externe Ressourcen über HTTPS eingebunden

- Canonical-Tags auf HTTPS-Versionen verweisen

- XML-Sitemap nur HTTPS-URLs enthalten

Mixed Content-Probleme entstehen, wenn HTTPS-Seiten unsichere HTTP-Ressourcen laden. Browser blockieren zunehmend solche Inhalte, was zu fehlenden Bildern oder nicht funktionierenden Scripts führt.

Security Headers und zusätzliche Schutzmaßnahmen

Moderne Websites sollten zusätzliche Security-Header implementieren, die vor gängigen Angriffsszenarien schützen und gleichzeitig Vertrauen bei Nutzern und Suchmaschinen aufbauen.

Empfohlene Security Headers:

- Content-Security-Policy (CSP)

- X-Content-Type-Options

- X-Frame-Options

- Referrer-Policy

- Permissions-Policy

URL-Struktur und interne Verlinkung

Eine logische URL-Struktur erleichtert sowohl Nutzern als auch Suchmaschinen die Navigation und das Verständnis der Website-Hierarchie. Die technische Optimierung der URL-Architektur zahlt sich langfristig aus.

Sprechende URLs gestalten

URLs sollten den Inhalt der Seite widerspiegeln und für Menschen lesbar sein. Kryptische Parameter oder Session-IDs gehören nicht in öffentliche URLs.

Best Practices für URL-Strukturen:

- Kleinbuchstaben verwenden

- Bindestriche statt Unterstriche für Worttrennungen

- Kurz und prägnant halten (unter 75 Zeichen ideal)

- Relevante Keywords einbinden

- Keine Sonderzeichen oder Umlaute

- Flache Hierarchie bevorzugen (maximal 3-4 Ebenen)

Beispiel einer optimalen URL-Struktur: https://bitgi.de/seo/technische-optimierung statt https://bitgi.de/index.php?id=123&cat=seo&page=tech

Interne Verlinkung strategisch aufbauen

Die interne Verlinkungsstruktur verteilt Link-Equity (PageRank) durch die Website und definiert thematische Cluster. Wichtige Seiten sollten von vielen anderen Seiten verlinkt werden.

Strategien für effektive interne Verlinkung:

- Hub-Pages erstellen für wichtige Themenbereiche

- Breadcrumb-Navigation implementieren für klare Hierarchie

- Kontextuelle Links in Fließtexten platzieren

- Footer- und Header-Menüs strategisch nutzen

- Related-Content-Blöcke für thematische Verbindungen

- Anchor-Texte variieren und aussagekräftig formulieren

Eine Marketing-Strategie für Leads profitiert beispielsweise von starken internen Verlinkungen zu thematisch verwandten Inhalten.

JavaScript-Rendering und moderne Frameworks

Moderne Websites setzen zunehmend auf JavaScript-Frameworks wie React, Vue oder Angular. Diese bieten hervorragende Nutzererfahrungen, stellen aber besondere Anforderungen an die technische SEO Optimierung.

Server-Side Rendering vs. Client-Side Rendering

Die Wahl zwischen Server-Side Rendering (SSR) und Client-Side Rendering (CSR) hat erhebliche SEO-Auswirkungen. Google kann mittlerweile JavaScript rendern, aber SSR bietet dennoch Vorteile.

| Rendering-Methode | Vorteile | Nachteile | SEO-Eignung |

|---|---|---|---|

| Server-Side Rendering | Schnelle First Paint, voller HTML-Content sofort verfügbar | Höhere Server-Last, komplexere Implementierung | Optimal für SEO |

| Client-Side Rendering | Geringere Server-Last, interaktive Apps | Langsamere initiale Darstellung, JavaScript erforderlich | Erfordert zusätzliche Maßnahmen |

| Static Site Generation | Sehr schnell, sicher, skalierbar | Rebuild bei Content-Änderungen notwendig | Hervorragend für SEO |

| Hybrid (Next.js, Nuxt.js) | Kombiniert Vorteile, flexible Optimierung | Komplexere Architektur | Sehr gut für SEO |

Dynamic Rendering für kritische Inhalte

Für besonders kritische Inhalte kann Dynamic Rendering eine Lösung sein: Crawler erhalten vorgerendertes HTML, während Nutzer die JavaScript-Anwendung erleben. Google akzeptiert diese Methode als Übergangslösung.

Implementierungs-Tipps für JavaScript-Websites:

- Kritische Inhalte im initialen HTML ausliefern

- History API für URL-Änderungen nutzen

- Lazy Loading für Below-the-Fold-Inhalte

- Prerendering für wichtige Seiten

- Regelmäßige Tests mit Google Search Console

Duplicate Content vermeiden

Duplicate Content verwässert die Relevanz Ihrer Seiten und kann zu Ranking-Problemen führen. Die technische Vermeidung ist essentiell für erfolgreiche Suchmaschinenoptimierung.

Technische Ursachen für Duplicate Content

Viele Duplicate Content-Probleme entstehen durch technische Konfigurationen, nicht durch absichtlich kopierte Inhalte.

Häufige technische Ursachen:

- Unterschiedliche URL-Varianten (www vs. non-www, HTTP vs. HTTPS)

- URL-Parameter für Tracking oder Session-IDs

- Druckversionen oder mobile Versionen unter separaten URLs

- Paginierung ohne korrekte rel="next/prev"-Tags

- Facettierte Navigation in Online-Shops

- Content-Syndication ohne Canonical-Tags

Die Lösung liegt in der korrekten Implementierung von 301-Weiterleitungen, Canonical-Tags und der Konfiguration der bevorzugten Domain in der Google Search Console.

Canonical-Tags professionell einsetzen

Der Canonical-Tag ist das wichtigste Werkzeug gegen Duplicate Content. Er signalisiert Suchmaschinen, welche Version einer Seite die primäre ist.

Regeln für Canonical-Tags:

- Jede Seite sollte einen Self-Referencing-Canonical haben

- Canonical sollte auf die bevorzugte URL-Version zeigen

- Relative URLs vermeiden, absolute URLs verwenden

- Konsistenz über alle URL-Varianten hinweg

- Canonical-Ketten vermeiden (A→B→C)

Log-File-Analyse und Crawl-Budget-Optimierung

Die Analyse von Server-Log-Files liefert tiefe Einblicke in das Crawling-Verhalten von Suchmaschinen. Diese Daten sind Gold wert für die technische SEO-Optimierung.

Was Log-Files verraten

Server-Logs zeigen genau, welche Seiten wie oft von welchen Crawlern besucht werden. Diese Informationen decken ineffiziente Crawl-Muster auf.

Wichtige Erkenntnisse aus Log-File-Analysen:

- Welche Seiten werden häufig gecrawlt, welche ignoriert?

- Verschwenden Crawler Zeit mit unwichtigen Seiten?

- Wie schnell entdeckt Google neue Inhalte?

- Gibt es Crawl-Fehler oder Server-Probleme?

- Welche Bereiche der Website erhalten zu wenig Crawl-Budget?

Besonders große Websites mit Tausenden von Seiten profitieren von Log-File-Analysen. Sie ermöglichen gezielte Optimierungen der robots.txt, der internen Verlinkung und der Sitemap-Priorisierung.

Crawl-Budget effizient nutzen

Das Crawl-Budget bezeichnet die Anzahl der Seiten, die Google bereit ist, in einem bestimmten Zeitraum zu crawlen. Bei kleinen Websites ist dies selten ein Problem, bei großen E-Commerce-Plattformen oder Content-Portalen aber kritisch.

Strategien zur Crawl-Budget-Optimierung:

- Unwichtige Seiten blockieren (Filterseiten, Suchresultate, Login-Bereiche)

- Server-Performance verbessern für schnellere Antwortzeiten

- Fehlerhafte URLs reduzieren (404, 500-Fehler)

- Redirect-Ketten eliminieren

- XML-Sitemap aktuell halten nur mit indexierbaren URLs

- Wichtige Inhalte prominent verlinken

Für Branchen wie Hotels in Frankfurt oder Immobilien in Frankfurt mit häufig wechselnden Verfügbarkeiten ist eine effiziente Crawl-Budget-Nutzung besonders wichtig.

Internationalisierung und Hreflang

Websites, die mehrere Sprachen oder Länder bedienen, benötigen korrekte Hreflang-Implementierung. Diese technische Maßnahme verhindert, dass Nutzer die falsche Sprachversion angezeigt bekommen.

Hreflang-Tags korrekt implementieren

Hreflang-Tags signalisieren Google, welche Sprachversion für welches Publikum gedacht ist. Die Implementierung ist fehleranfällig und erfordert Präzision.

Implementierungs-Optionen:

- HTML-Tags im

<head>-Bereich jeder Seite - HTTP-Header für PDF- oder andere Nicht-HTML-Dateien

- XML-Sitemap mit Hreflang-Annotationen

Ein Beispiel für deutschen und englischen Content:

<link rel="alternate" hreflang="de" href="https://example.com/de/" />

<link rel="alternate" hreflang="en" href="https://example.com/en/" />

<link rel="alternate" hreflang="x-default" href="https://example.com/" />

Häufige Hreflang-Fehler:

- Fehlende Rückverweise (de→en existiert, aber en→de fehlt)

- Falsche Sprachcodes (de-DE statt de)

- Hreflang auf nicht existierende URLs

- Fehlende x-default-Variante

- Konflikte mit Canonical-Tags

Fehlerseiten und Statuscodes optimieren

HTTP-Statuscodes kommunizieren den Status jeder Anfrage. Die korrekte Verwendung ist fundamental für technische SEO Optimierung.

404-Fehlerseiten nutzerfreundlich gestalten

404-Fehler sind unvermeidbar, besonders bei älteren, umfangreichen Websites. Eine optimierte 404-Seite minimiert den Schaden und bietet Nutzern Alternativen.

Elemente einer optimalen 404-Seite:

- Klare Erklärung, dass die Seite nicht existiert

- Suchfunktion zur Inhaltsfindung

- Links zu beliebten oder wichtigen Seiten

- Navigation zur Startseite

- Humorvolle oder markenkonforme Gestaltung

- Korrekte HTTP 404-Statuscode (nicht 200 oder 302!)

Weiterleitungen strategisch einsetzen

301-Weiterleitungen sind essentiell beim Relaunch, bei URL-Änderungen oder beim Entfernen von Seiten. Sie leiten sowohl Nutzer als auch Link-Equity zur neuen URL weiter.

| Statuscode | Bedeutung | SEO-Verwendung |

|---|---|---|

| 301 | Permanent verschoben | Für dauerhafte URL-Änderungen, überträgt ~90% des Link-Equity |

| 302 | Temporär verschoben | Für vorübergehende Änderungen, überträgt kein Link-Equity |

| 307 | Temporäre Weiterleitung (HTTP/1.1) | Selten verwendet, für temporäre Änderungen mit Methodenbeibehaltung |

| 410 | Permanent gelöscht | Signalisiert, dass Inhalt absichtlich entfernt wurde |

Best Practices für Weiterleitungen:

- Direkte Weiterleitungen ohne Ketten

- Thematisch passende Zielseiten wählen

- Weiterleitungs-Mappings bei Relaunches dokumentieren

- Regelmäßig auf veraltete Weiterleitungen prüfen

Monitoring und kontinuierliche Optimierung

Technische SEO ist kein einmaliges Projekt, sondern ein kontinuierlicher Prozess. Regelmäßiges Monitoring identifiziert Probleme, bevor sie Rankings beeinträchtigen.

Essentielle Tools für technisches SEO-Monitoring

Eine Kombination verschiedener Tools liefert umfassende Einblicke in die technische Performance.

Unverzichtbare Monitoring-Tools:

- Google Search Console – Indexierungsstatus, Crawl-Fehler, Core Web Vitals

- Google PageSpeed Insights – Performance-Metriken und Optimierungsvorschläge

- Screaming Frog SEO Spider – Technische Website-Audits

- GTmetrix oder WebPageTest – Detaillierte Performance-Analysen

- Log-Analyzer – Crawling-Verhalten verstehen

- Uptime-Monitoring – Verfügbarkeit überwachen

Für spezialisierte Branchen wie Autowerkstätten in Frankfurt oder Apotheken in Frankfurt sollten zusätzlich lokale Rankings und Google-Maps-Positionen überwacht werden.

Alerts und automatisierte Überwachung

Automatisierte Alerts informieren Sie sofort über kritische Probleme, bevor sie sich auf Rankings auswirken.

Wichtige Alert-Kategorien:

- Drastische Anstiege bei 404- oder 500-Fehlern

- Plötzlicher Rückgang gecrawlter Seiten

- Verschlechterung der Core Web Vitals

- SSL-Zertifikats-Ablauf

- Downtime oder langsame Server-Response

- Indexierungs-Probleme bei wichtigen Seiten

Advanced Technical SEO für 2026

Die technische Landschaft entwickelt sich ständig weiter. Einige fortgeschrittene Themen gewinnen 2026 besonders an Bedeutung.

Optimierung für KI-Suchsysteme

KI-basierte Suchsysteme wie ChatGPT, Perplexity oder Google SGE (Search Generative Experience) ändern, wie Nutzer Informationen finden. Die technische Vorbereitung darauf ist Teil moderner SEO-Strategien.

Technische Anpassungen für KI-Suche:

- Strukturierte Daten noch umfassender implementieren

- FAQ-Schema für häufige Fragen nutzen

- Klare, kontextreiche Überschriften-Hierarchie

- API-Zugriffe für KI-Crawler ermöglichen

- Semantische HTML5-Tags konsistent verwenden

Progressive Web Apps (PWA) und App-Like Experience

Progressive Web Apps kombinieren Web- und App-Funktionalität. Sie bieten offline-Verfügbarkeit, Push-Benachrichtigungen und schnelle Ladezeiten.

SEO-Vorteile von PWAs:

- Drastisch verbesserte Performance-Metriken

- Offline-Funktionalität erhöht Engagement

- App-Shell-Architektur für sofortige Interaktivität

- Bessere mobile Nutzererfahrung

- Höhere Conversion-Raten

Die technische Implementierung erfordert Service Worker, ein Web App Manifest und HTTPS. Die SEO-Benefits resultieren primär aus verbesserter Performance und Nutzererfahrung.

Edge Computing und CDN-Optimierung

Edge Computing bringt Inhalte näher an Nutzer heran, indem sie auf geografisch verteilten Servern ausgeliefert werden. Moderne CDNs bieten mehr als nur statisches Caching.

Advanced CDN-Features für SEO:

- Edge Side Includes (ESI) für dynamische Inhalte

- Image Optimization on-the-fly in modernen Formaten

- Automatisches Minifying von CSS und JavaScript

- HTTP/3 und QUIC für schnellere Verbindungen

- Geolocation-basiertes Routing für optimale Latenz

Für Unternehmen wie Friseure in Frankfurt oder Handwerker in Frankfurt, die primär lokal agieren, optimiert ein CDN besonders die Erreichbarkeit aus der Region.

Technisches SEO-Audit durchführen

Ein systematisches Audit identifiziert Schwachstellen und Optimierungspotenziale. Die Struktur sollte alle wesentlichen Bereiche abdecken.

Audit-Checkliste für umfassende Analysen

Eine strukturierte Vorgehensweise stellt sicher, dass keine kritischen Aspekte übersehen werden.

Umfassende Audit-Bereiche:

Crawlability & Indexierung

- Robots.txt-Konfiguration prüfen

- XML-Sitemaps validieren

- Indexierungsstatus in Search Console analysieren

- Crawl-Fehler identifizieren und beheben

Performance & Core Web Vitals

- LCP, FID, CLS messen und bewerten

- Server-Response-Zeiten analysieren

- Ressourcen-Größen und Ladezeiten prüfen

- Render-Blocking-Ressourcen identifizieren

Mobile Optimierung

- Mobile Usability testen

- Responsive Design verifizieren

- Touch-Elemente prüfen

- Mobile Performance separat messen

Site Architecture

- URL-Struktur evaluieren

- Interne Verlinkung analysieren

- Navigationshierarchie prüfen

- Informationsarchitektur bewerten

Security & Technical Setup

- HTTPS-Implementierung validieren

- Security Headers überprüfen

- Mixed Content identifizieren

- SSL-Zertifikat-Status kontrollieren

Structured Data & Schema

- Vorhandenes Markup validieren

- Implementierungs-Lücken identifizieren

- Rich Results Eignung prüfen

- Fehler in strukturierten Daten beheben

Priorisierung von Optimierungsmaßnahmen

Nicht alle identifizierten Probleme haben die gleiche Dringlichkeit. Eine Impact-Effort-Matrix hilft bei der Priorisierung.

| Priorität | Impact | Aufwand | Beispiele |

|---|---|---|---|

| Kritisch | Hoch | Beliebig | Indexierungs-Blockaden, schwere Performance-Probleme, Security-Issues |

| Hoch | Hoch | Niedrig-Mittel | Core Web Vitals-Verbesserungen, strukturierte Daten ergänzen |

| Mittel | Mittel | Niedrig | URL-Optimierungen, interne Verlinkung verbessern |

| Niedrig | Niedrig | Hoch | Nice-to-have-Features, marginale Performance-Tweaks |

Beginnen Sie mit kritischen Problemen, die die Indexierung oder Sicherheit betreffen. Diese können Rankings komplett verhindern.

Branchen-spezifische technische Optimierungen

Unterschiedliche Branchen haben spezifische technische Anforderungen. Die Optimierung sollte diese Besonderheiten berücksichtigen.

Local SEO für standortgebundene Unternehmen

Unternehmen mit physischen Standorten wie Arztpraxen in Frankfurt oder Zahnarztpraxen in Frankfurt benötigen spezielle technische Optimierungen.

Technische Local-SEO-Maßnahmen:

- Standort-spezifische Landing Pages mit einzigartigen Inhalten

- NAP-Konsistenz (Name, Address, Phone) über alle Plattformen

- LocalBusiness-Schema mit vollständigen Informationen

- Geo-Tags in Bildern und Metadaten

- Google Maps Integration auf der Website

- Strukturierte Öffnungszeiten im Schema

- Separate URLs für verschiedene Standorte

E-Commerce und produktintensive Websites

Online-Shops stehen vor besonderen technischen Herausforderungen durch große Produktkataloge, facettierte Navigation und dynamische Inhalte.

E-Commerce-spezifische Optimierungen:

- Facettierte Navigation mit Parameter-Handling

- Product-Schema mit Preisen, Verfügbarkeit, Bewertungen

- Canonicalization bei Produktvarianten

- Pagination für Kategorie-Seiten

- Strukturierte Daten für Breadcrumbs

- Optimierte Checkout-Prozesse

- Lazy Loading für Produktbilder

Service-basierte Unternehmen

Dienstleister wie Anwälte in Frankfurt oder Gastronomie in Frankfurt profitieren von anderen technischen Schwerpunkten.

Technische Optimierung für Dienstleister:

- Service-Schema für angebotene Leistungen

- FAQ-Schema für häufige Kundenfragen

- Review-Schema für Kundenbewertungen

- Appointment-Integration mit Schema

- Klare Service-Seiten mit H1-H3-Hierarchie

- Kontaktformular-Optimierung für Conversions

Die technische SEO Optimierung bildet das unverzichtbare Fundament jeder erfolgreichen digitalen Strategie. Von der grundlegenden Crawlability über Performance-Metriken bis hin zu fortgeschrittenen Themen wie KI-Optimierung – jeder Aspekt trägt zu besserer Sichtbarkeit und höheren Rankings bei. Die Investition in eine professionelle technische Optimierung zahlt sich durch messbar bessere Suchergebnisse, qualifiziertere Besucher und langfristiges Wachstum aus. BITGI unterstützt Sie dabei, Ihre digitale Präsenz technisch optimal aufzusetzen und bei Google, Google Maps sowie KI-Suchsystemen dauerhaft sichtbar zu werden. Mit datenbasiertem Ansatz und fokussierter Expertise sorgen wir dafür, dass potenzielle Kunden Sie genau dann finden, wenn sie nach Ihren Leistungen suchen.